La théorie de l'apprentissage de Vapnik et les progrès récents de l'IA

By Yann LeCun

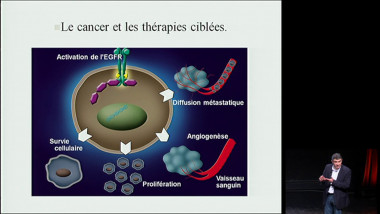

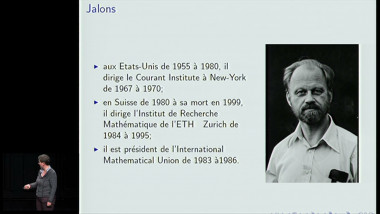

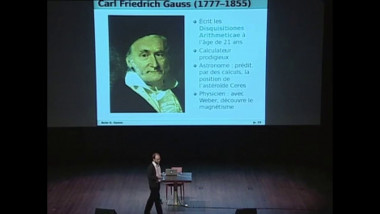

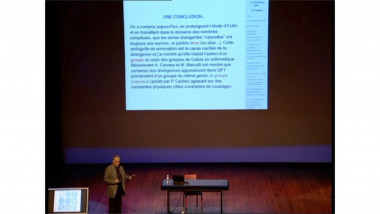

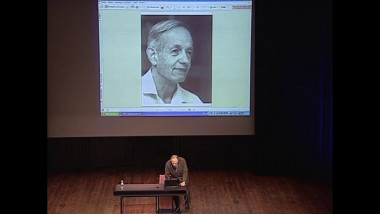

L'explosion récente de l'intelligence artificielle et de ses applications est due en grande partie à l'utilisation de l'apprentissage machine, particulièrement des techniques d'apprentissage profond. Les idées fondatrices de l'apprentissage machine remontent aux années 50, et celles de l'apprentissage profond aux année 80. Les applications pratiques ont explosé ces dernières années, des voitures autonomes à la traduction, la recherche d'information et la médecine personnalisée. Mais que dit la théorie ? La formulation mathématique la plus générale des processus d'apprentissage est celle du mathématicien Russe émigré aux Etats-Unis Vladimir Vapnik. Dans son petit livre publié en 1995 "La Nature de la Théorie Statistique de l'Apprentissage", Vapnik décrit les conditions générales dans lesquelles un système, informatique ou biologique, peut apprendre une tâche, et à quelle vitesse. Mais cette théorie générale n'explique pas pourquoi les méthodes modernes d'apprentissage profond fonctionnent si bien, bien mieux que les méthodes plus simples mais mathématiquement mieux comprises.