Variations sur l'information : catégories, cohomologie, entropie

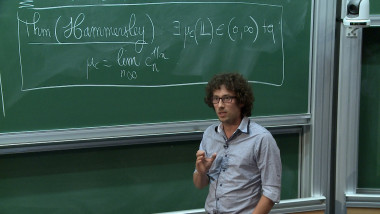

L'entropie d'une variable aléatoire discrète, introduit par Shannon et généralisé par Kolmogorov, Sinai et autres, satisfait l'identité 0=H(Y|X)-H(XY)+H(X). On verra que, si on considère une catégorie S de “observables” et un topos de Grothendieck associé à ce catégorie (les préfaisceaux sur S), l'égalité ci-dessus s'interprète au niveau cohomologique comme une condition de cocycle. Sous certaines hypothèses, l'entropie apparaît comme le générateur du premier groupe de “cohomologie de l'information”, introduit par Benenquin-Baudot l'année dernière. On parlera de cette approximation catégorique aux probabilités classiques et quantiques; quelques constructions de Gromov seront aussi mentionnés.